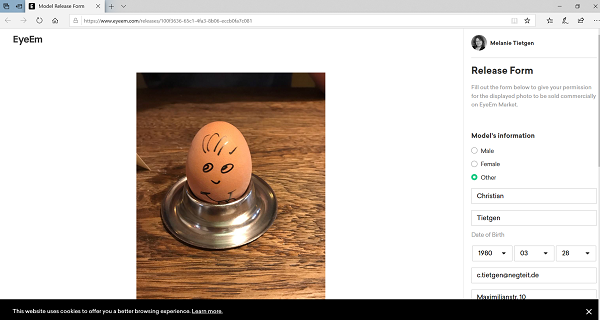

Im ersten Moment war es lustig. Man nehme ein Ei, male ein Gesicht darauf, und lächle. Danach macht man ein Foto davon, und will es ins Internet hochladen. In diesem Fall auf die Bilderplattform EyeEm.

Der Uploadfilter erkennt jedoch ein Gesicht, und verhindert die öffentliche Freigabe. Daraufhin gibt meine Frau – wie von der Plattformtechnik gewünscht, den Namen und die E-Mailadresse des Models an. Da sie aber das Ei schlecht um Erlaubnis fragen kann, und selbiges auch über keine E-Mailadresse verfügt, gibt meine Frau meine E-Mailadresse und meinen Namen an.

Kurz darauf erhalte ich eine Nachricht via Mail. Bin ich wirklich das Ei? Darf das Bild öffentlich freigegeben werden? Ich gebe mein Einverständnis durch Klicks auf Links – fertig. Kurz darauf wird das Eiergesicht freigegeben.

Was beim Abendessen noch ein belustigendes Thema war, ist im Nachgang gar nicht mehr so lustig. Denn erstens wurde ein Ei als realer Mensch erkannt, und im Prinzip hätte das Bild durch jeden freigegeben werden können – einschließlich einer Fake-E-Mailadresse.

Besonders Fatal ist es jedoch, das es bereits ein echtes Bild mit mir auf EyeEm gibt, welches mit meiner E-Mailadresse verknüpft ist. Da das Eigesicht mir nun wirklich gar nicht ähnlich sieht, kann man daraus ableiten, das die Informationen nicht miteinander verglichen wurden. Und ein echter Mensch steht da bei der Prüfung auch nicht dahinter. Einem Menschen wäre der Blödsinn aufgefallen.

Ein Uploadfilter erkennt Gesichtszüge, aber kein Gesicht.

Die Politik gaukelt uns mehr Sicherheit durch mehr Überwachung vor. Ich habe da so meine Zweifel dran.

In einem älteren Beitrag aus 2016, den man hier findet, glaubte Facebook, ich sei in Pakistan – und in Gefahr.

Ich lasse das jetzt mal so stehen. Da kann sich jeder selbst mal ein paar Gedanken dazu machen. 🙂

Hier ist das Eigesicht. Und hier, das bin ich.